Wenn im Namen der Effizienz KI blind in der Verwaltung eingesetzt wird, dann hat es nicht nur Folgen für – aber insbesondere – marginalisierte Gruppen sondern auch für die Gesellschaft insgesamt, die dann wie bei der Kredit- und Wohnungsvergabe und bei der Bewerbung auf intransparente Verfahren stoßen. Dadurch würden wir als Bürger und Bürgerinnen nicht nur entmenschlicht werden, sondern am Ende der Entwicklung wie Kunden eines Unternehmens behandelt werden wo nur Profit maßgeblich ist.

(Quelle: Aceshowbiz)

Der repräsentative Ansatz und der probabilistische Ansatz

In einem repräsentativen Ansatz geht es darum, zuerst die objektiven Fakten über einen Einzelfall zu ermitteln mit der dann eine begründete Einzelfallentscheidung getroffen werden kann, die dem Fall gerecht wird.

In einem probabilistischen Ansatz geht es darum, Entscheidungen so zu treffen sind dass sie bei aggregierter (= angehäufter) Betrachtung kostensparend und damit effizient sind.

Letzteres kann leicht zu Lasten von marginalisierten Gruppen gehen die über schlechtere Ressourcen des Rechtsschutzes verfügen oder untypische Fälle darstellen. Da KI-Systeme Erfahrungsbasiert arbeiten, sich also aus dem Erfahrschungsschatz bisheriger bürokratischer Daten speisen, wird diese Logik auch in ihre Mustererkennung einfließen und bei entsprechender Seltenheit werden die Gruppen häufiger falsch behandelt.

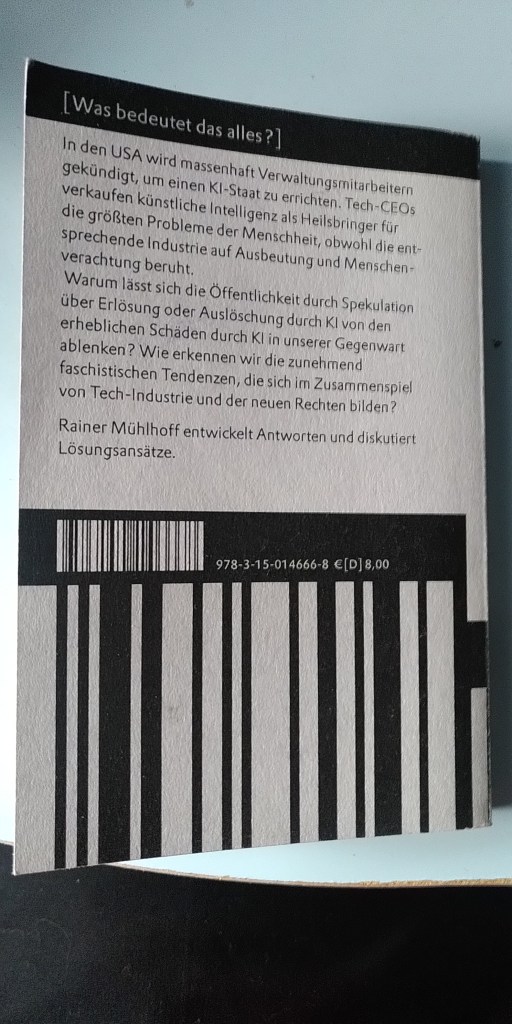

In dem Buch „Künstliche Intelligenz und der neue Faschismus“, verfasst von Rainer Mühlhoff und publiziert vom Reclam Verlag, wird auch zuvor ein Beispiel genannt wie ein repräsentativer Ansatz in unseren Bürokoratie momentan aussehen würde. Die oben genannten Ansätze und Erläuterungen sind auf S. 43-44 zu finden.

Auszug aus dem Buch (S. 39-43)

Stellen wir uns vor, wir wären in einer fiktiven Bundesagentur für Arbeit für die Leitung einer Abteilung verantwortlich, die über die Verhängung einer sogenannten Sperrzeit beim Bezug von Arbeitslosengeld entscheidet. Solche Sperrzeiten stellen eine Sanktionsmaßnahme dar, die etwa dann verhängt wird, wenn die versicherte Person ihren Arbeitsvertrag ohne wichtigen Grund von sich aus gekündigt hat. Es wären nun zwei verschiedene Arbeitsweisen für unsere Abteilung vorstellbar:

In der einen Arbeitsweise – nenne wir sie die >regelbasierte< [repräsentativer Ansatz] – ist eine große Zahl an Sachbearbeiter/innen damit befasst, jeden einzelnen Fall hinsichtlich der formalen Kriterien für Sperrzeiten einzuordnen und im Anschluss eine fallbezogene Entscheidung zu treffen. Hat die Persone ihre Arbeitsstelle selbst gekündigt? Wenn dies der Fall sein sollte: Könnte es wiederum Umstände geben, die eine Sanktion verhindern würden, etwa den Umstand, dass der Arbeitsvertrag wegen einer Befristung ohnehin bald ausgelaufen wäre? Oder erfolgte die Kündigung aus einem >wichtigen Grund<, etwa wegen Mobbing, aus gesundheitlichen Gründen oder wegen Gehaltsrückstands? Wenn dies nicht der Fall sein sollte: Erfolgte eine Kündigung durch den Arbeitgeber wegen Fehlverhaltens? …

Die Sachbearbeiter/innen nehmen nach diesem Muster für jeden Antrag eine Einzelfallprüfung vor. Mit der dafür nötigen Einordnung bzw. Subsumption eines Falls unter die Kriterien des Tatbestands ist unweigerlich eine Interpretationsleistung verbunden, etwa bei der Extraktion der relevanten Informationen aus Arbeitszeugnissen, Kündigungsschreiben, Beweismaterial für Mobbing oder ärztliche Gutachten. Hinsichtlich der Rechtsfolgen besteht sodann innerhalb der gesetzlich festgelegten Grenzen ein Ermessungsspielraum: Die Sanktionsmaßnahme kann durch die Sachbearbeiter/innen fallspezifisch strenger oder milder bemessen werden.

Dieses Verfahren ist aufwendig und schlecht skalierbar, aber transparent. Wenn man eine Entscheidung nachvollziehen möchte, kann man sich jeden Schritt einzeln anschauen und ihn sachlich begründen. Zur Qualitätssicherung würden wir als engagierte Abteilungsleiter/innen alle Sachbearbeiter/innen regelmäßig schulen, so dass möglichst einheitliche Maßstäbe bei Interpretationen und Ermessensentscheidungen von allen Beteiligten übernommen werden. Wir würden Regeln dafür einrichten, welche Grenzfälle an die Vorgesetzten übergeben werden müssen, und wir würden stichprobenartig die ausgehenden Bescheide überprüfen, um möglichst frühzeitig Unregelmäßigkeiten in der Arbeitsweise erkennen zu können.

Ist die Antragsteller/in mit der Entscheidung ihres Falls am Ende nicht einverstanden, kann sie bei unsere Behörde Widerspruch einlegen und, sollte der nicht erfolgreich sein, die Entscheidung gerichtlich anfechten. In diesem Fall käme erneut die Möglichkeit zum Tragen, dass jeder Schritt sachlich begründet und überprüft werden kann. Gerichte können zu der Erkenntnis kommen, dass eine bestimmte Ermessensentscheidung unverhältnismäßig war oder den Grundsatz der Gleichbehandlung missachtet. Der Fall würde dann an die Behörde zurückgegeben, die unter Berücksichtigung der Rechtsauffassung des Gerichts neu entscheiden und den Ermessungsfehler korrigieren müsste.

Die zweite Arbeitsweise arbeitet auch mit dem menschlichen Rahmen, also dass die Beamten nach der Logik einer KI arbeiten. Daher sollten Sie die Mitarbeitenden als Analogie zu einem einzelnen KI-System sehen, bei einer schlechten Entscheidung gibt es demnach keine finanzielle Sanktion (z. B. Gehaltskürzung) sondern >reinforcement learning< (Einspeisung von Ergebnissen von Widerspruchs- und Klageverfahren als Trainigdaten, vgl. S. 44).

Skizzieren wir für einen Vergleich nun noch eine zweite, andersartige und >innovative< Arbeitsweise unser fiktiven Abteilung, die wir >>erfahrungsbasierte<< [probabilisitscher Ansatz] nennen könnten. Diese Vorgehensweisen beruht darauf, ein Team von Mitarbeitenden möglichst lange im Job zu halten, so dass sich bei diesen sehr viel Erfahrung mit den Entscheidungen über Sperrzeiten ansammelt. Diese Mitarbeitenden haben dann so viele Fälle in ihrem Leben bearbeitet, dass sie jedem neuen Fall, der aus den relevanten Unterlagen wie Schriftverkehr, Antragsformular, Gutachten und Zeugnissen besteht, mit hoher Treffsicherheit schnell ansehen können, ob er aller Wahrscheinlichkeit nach mit einer Sperrzeit belegt werden sollte oder nicht. Aufgrund ihrer Erfahrung erkennen unsere Mitarbeitenden also die typischen Verhaltensmuster, sollte etwa jemand gezielt seine Kündigung provoziert haben; sie kennen alle Tricks, mit denen ein wichtiger Grund für eine Selbstkündigung konstruiert wird; sie wissen auch, welche Chance ein gesundheitliches Argument vor Gericht haben könnte, als ein wichtiger Grund anerkannt zu werden.

Die Entscheidungen über Sperrzeiten werden in der erfahrungsbasierten Arbeitsweise unsere Abteilung von den Mitarbeitenden aus dem Bauch heraus gefällt. Wir als Abteilung gehen davon aus, dass die Entscheidung nach Bauchgefühl viel schneller getroffen werden und in vielen Fällen ausreichend genau sind, so dass es sich in der Summe nicht lohnt, für jeden Vorgang eine Einzelfallprüfung vorzunehmen. Stattdessen entscheidet unsere Abteilung immer so, dass das höchstwahrscheinliche >so durchgehen wird<. Dabei werden wir natürlich Fehler machen, doch nach unserer Auffassung wird es trotzdem effizienter sein, einige Widerspruchs- und Klageverfahren in Kauf zu nehmen, in denen dann korrigiert werden würde, wenn unsere Mitarbeitenden in ihrem Bauchgefühl falschgelegen haben sollten.

Um in dieser Arbeitsweise Willkür und Nachlässigkeit der Mitarbeitenden zu reduzieren und gleichzeitig den Erfahrungsschatz der Abteilung ständig anwachsen lassen, installieren wir als engagierte Abteilungsleiter/innen clever Feedback- und Saktionierungsmechanismen: Wir spielen an die Mitarbeitenden zurück, welche ihrer Entscheidung nachgelagert angefochten wurden und welche dieser Verfahren erfolgreich waren. Wir installieren außerdem ein Bonussystem, das jene Mitarbeitenden finanziell belohnt, die mit ihrer Einschätzung überdurchschnittlich richtiglagen (was wir daran messen, dass sie kein Widerspruchs- oder Gerichtsverfahren provozieren), Abzüge vom Lohn erfolgen dann, wenn Entscheidungen überdurchschnittlich häufig erfolgreich angefochten werden.

In beiden Beispielen ist zudem der Idealfall zu sehen, wenn also auch der politische Wille nach der Gestaltung da ist. Beim ersteren wäre es heute noch möglich es noch so umzugestalten; wenn jedoch das letztere nur halbherzig umgesetzt wird, dann gibt es keine zwischenmenschliche Instanz die noch einschreiten kann und die Resultate wären noch schlechter. Autokratische Bewegungen und Parteien würden sich noch weniger darum kümmern, wenn überhaupt, da sie sich sozialdarwinistisch orientieren.

Politische und Ethische Konsequenzen

Das oben gezeigte Beispiel mit dem probabilistischen Ansatz würde dann nicht auf das Arbeitsamt beschränkt bleiben, sondern auch früher oder später auf die anderen Ämter übertragen werden. Immer mit der Argumentation der Effizienz und Kostenersparnis, während die Lebensqualität der Bürger und Bürgerinnen immer mehr abnimmt und selbst rechtsstaatliche Prinzipien Gefahr laufen überfahren zu werden.

Stellen Sie sich z. B. einen Handwerksbetrieb oder eine Landwirtschaftsbetrieb in einer strukturschwachen Region vor und eine zukünftige Regierung die sich das Ziel gesetzt hat, mithilfe KI nur dort besonders stark zu fördern wo auch mehr Steuereinnahmen erzielt werden können um diese Investitionskosten schnell decken zu können. Die Künstliche Intelligenz (KI) sammelt zuerst alle Daten bezüglich der Einwohnerzahl, dem durchschnittlichen Einkommen, der Anzahl von Unternehmen und die vorhandene Infrastruktur; dann rechnet die KI aus, welche Investitionen kurzfristig (z. B. 4-8 Jahre) mehr Steuereinnahmen generiert um schließlich jene Kommunen und Städte zu empfehlen die diese Kriterien erfüllen. Wenn Sie in einer strukturschwachen Region leben die zwar das Potential hat mit großen Investitionen innerhalb von 5-10 Jahren, oder etwas länger, ebenfalls einen ähnlichen oder gleichen Wohlstand zu erreichen wie jene die die Kriterien bereits erfüllen, dann haben Sie Pech gehabt. Als Landwirt oder Handwerksbetrieb werden Sie dann Schwierigkeiten haben mit den finanziell geförderten Kommunen und Städten mitzuhalten, vielleicht ziehen sogar noch mehr Menschen weg und die Situation verschlimmert sich nur noch mehr. Dadurch entsteht ein neuer Teufelskreis.

Marginalisierte Gruppen, wie z. B. die Afro-Amerikaner in den USA die sich kein generationsübergreifenden Wohlstand aufbauen konnten weil die US-Regierung nach dem Ende des Zweiten Weltkriegs nur den weißen amerikanischen Soldaten kostenlose Bildung zukommen ließen, werden durch ein KI-System dieser Art ebenfalls weiter benachteiligt.

Durch die sozioökonomische Situation von margnialisierten Personengruppen, wie sie es auch in Deutschland und vielen anderen Ländern gibt, haben sie nicht diesselbe Ressourcen zur Verfügung (wozu auch Zeit gehört, weil sie entweder zahlreiche Überstunden machen müssen oder mehr als einen Job haben um ihren Kopf über Wasser zu halten) und können deswegen auch nicht immer – wenn überhaupt – Widerspruch einlegen oder dagegen klagen. Aufgrund politischer Diskussionen, in denen regelmäßig nach unten getreten wird von liberaler, konservativer und rechtsextremer Seite, wird zudem ein Stigma kreiert welches mehr Menschen abschreckt Sozialleistungen in Anspruch zu nehmen obwohl sie es dringend brauchen. Erben und reiche Aktionäre, die hingegen nichts geleistet haben, werden sogar geschützt und durch eine Befürwortung einer Abschaffung der Erbschaftssteuer und Verhinderung einer Finanztransaktionssteuer noch wohlhabender gemacht. Gleichzeitig werden auch andere Vorurteile von den KI-Systemen übernommen, wie etwa rassistische oder sexistische Einstellungen, wenn dies auf anderen Ebenen ohne Reflexion eingesetzt wird. Da es dann von einer Maschine kommt, kann einfach argumentiert werden dass es sich hier nur um Zahlen handle die ja nicht lügen könnten.

Bestehende Ungleichheiten würden verstärkt und damit vielleicht sogar endgültig zementiert, Millionen von unseren Mitbürgern und Mitbürgerinnen würden als Bürger zweiter Klasse behandelt werden und die Macht der bereits großen Technologie-Konzerne wie Meta, Microsoft, Amazon und Google (nun Alphabet Inc.) würden sich um ein vielfaches stärker in den Händen der wenigen Milliardäre konzentrieren die direkt und indirekt von der Spaltung unserer Gesellschaft und Aushöhlung unserer Demokratie profitieren würden. Im Gegensatz zu den Behauptungen der Tech-Millardäre ist die Zukunft aber nicht festgeschrieben – weder deren Heilsversprechen noch die heraufbeschworene mögliche Apokalypse sind Real, sie sind nur Teil eines nun religiösen KI-Hypes.

Rechtsstaatlich wäre das KI-System auch fatal, denn ein Rechtsstaat ist mehr als die Gewaltenteilung in Legislative (Gesetzgebung), Exekutive (vollziehende Gewalt) und Judikative (Rechtssprechung). So zählt dazu auch die Rechtssicherheit und die Rechtsklahrheit: Gesetze müssen publiziert und allgemein verständlich sein. Jeder Bürger muss seine Rechte und Pflichten kennen und sich auf ihren Bestand verlassen können.

Das Gesetz hat alle gleich zu behandeln und es herrscht ein Verbot der Rückwirkung.

Und hier kommt das wichtigste in Bezug auf das fiktive KI-System: die Justiziabilität.

Strittige Rechtsfragen müssen gerichtlich überprüfbar sein. Dies wird vor allem durch das Recht auf den gesetzlichen Richter (Artikel 101 Absatz 1 Satz 2 GG) und durch die Garantie eines effektiven Rechtsschutzes (Artikel 19 Absatz 4 GG) gewährleistet. Eine Einzelfallüberprüfung gewährt eben dies und macht es für den durchschnittlichen Bürger einfacher nachzuvollziehen warum etwas nicht zustandegekommen ist. Ein System was dies absichtlich erschwert und die bestehende Ungleichheiten ausnutzt ist unethisch.

Auch wichtig ist die Grundrechtebindung der Staatsgewalt: dies sind die Artikel 1 bis 19 GG (Grundgesetz) welche dem Schutz der individuellen Freiheit und der Würde des Menschen dienen.

Künstliche Intelligenz sollte nur insoweit eingesetzt werden, wie sie unsere Lebensqualität verbessert – sei es am Arbeitsplatz, im öffentlichen Leben oder im privaten Bereich.

Anstatt also die Frage nach einer angeblichen „Effizienz und Kostenersparnis“ in der Bürokratie zu stellen, sollte die Frage lauten wie wir die Lebensqualität für die Menschen verbessern und wo zu viel Bürokratie herrscht die die Lebensqualität einschränkt. Dies geht aber nur indem mit den Menschen gesprochen wird die davon betroffen sind (wie sind sie dadurch eingeschränkt in ihrer Lebensqualität?), zu hinterfragen warum es diese bürokratische Hürde gibt (erfüllt sie was sie erfüllen sollte? Wurde zu viel aufeinandergestockt und ginge es auch mit weniger Vorschriften?) und dem politischen Willen dies auch so umzusetzen.

Wenn ich mir den momentanen „Gipfel der KI“ anschauen, was die Sora App ist, dann sehe ich nur einen armseligen Versuch von Sam Altman die Milliarden an Investitionen zu rechtfertigen. Es wird nach Lösungen für nicht-existierende Probleme gesucht, und alles was dabei herauskam ist eine gewaltiger Kunstraub an unzähligen Künstler und Künstlerinnen die ihre Kunstwerke auf Kunstplatformen wie ArtStation hochgeladen haben, oder sozialen Medien wie Instagram, Pinterest und ehemals Twitter, um sie in einer Gemeinschaft von geistesverwandten Mitmenschen zu teilen. Dann wären da noch die täuschendechten Videos die mittlerweile produziert werden können, zur Lasten der Umwelt und der Stromkosten der Bewohner in den USA die in der Nähe der Datenzentren nun leben, die keinerlei gesellschaftlichen und kulturellen Wert haben. Es wirkt sogar schon so, als ob die Täuschung durch KI-Videos und Fotos Sinn und Zweck von Sora und ähnlicher Software ist.

Schlussworte

Ein weiteres Problem mit den Tech-Milliardären und ihren Fokus auf einer höchstspekulativen AGI (= Artificial General Intelligence) ist, dass sie von den jetztigen Problem ablenkt die real sind und mit harten wissenschaftlichen Daten belegt sind: die Klimakrise, die großen sozialen Ungleichheiten und der enorme Ressourcen verbrauch.

Wenn dieser KI-Sommer vorbei ist, und die KI-Blase platz, dann sind es wieder wir die die Wirtschaftskrise ausbaden während sich Sam Altman und Co. wo hinfliegen lassen und ihren geheim abgezweigten Reichtum genießen.

Wir haben aber bereits die Technologie um das schlimmste der Klimakrise zu verhindern, und das ist vor allem die Förderung von erneuerbaren Energien (wie Wind- und Solarkraft), eine Umorientierung der Infrastruktur zur ÖVP- und Fahrradfreundlichkeit und ein Ausgleich der Vermögensungleichheit durch eine Vermögenssteuer.

Wir können nicht nur unseren Wohlstand erhalten, sondern auch den Wohlstand über Generationen hinaus sichern. Da kann ein Donald Trump, ein Markus Söder und eine Alice Weidel noch so viel herumlügen. Auf egoistische und machtgierige Individuen und Parteien hört man lieber nicht, ansonsten tritt der Wohlverstandsverlust wirklich ein.

Es wird auch höchste Zeit, dass wir auch technologisch unabhängiger werden: ob mit OpenDesk, Mastodon oder Linux. Nur so können wir als demokratische Öffentlichkeit dem Sillicon Valley etwas entgegensetzen und deren Macht einschränken. Open Source ist die Zukunft, und Länder wie Estland zeigen wie Digitalisierung demokratisch geht.

Quellen

Rechtsstaatzprinzip: Definition & Bedeutung im juristischen Kontext

https://www.juraforum.de/lexikon/rechtsstaatsprinzip

Buch-Titel: Künstliche Intelligenz und der neue Faschismus

Autor: Rainer Mühlhoff

Verlag: Reclam

Seitenanzahl: 160

ISBN: 978-3-15-014666-8

Preis: 8,00€